Multimodal2026-04-16 WIRED AI

WIRED AI

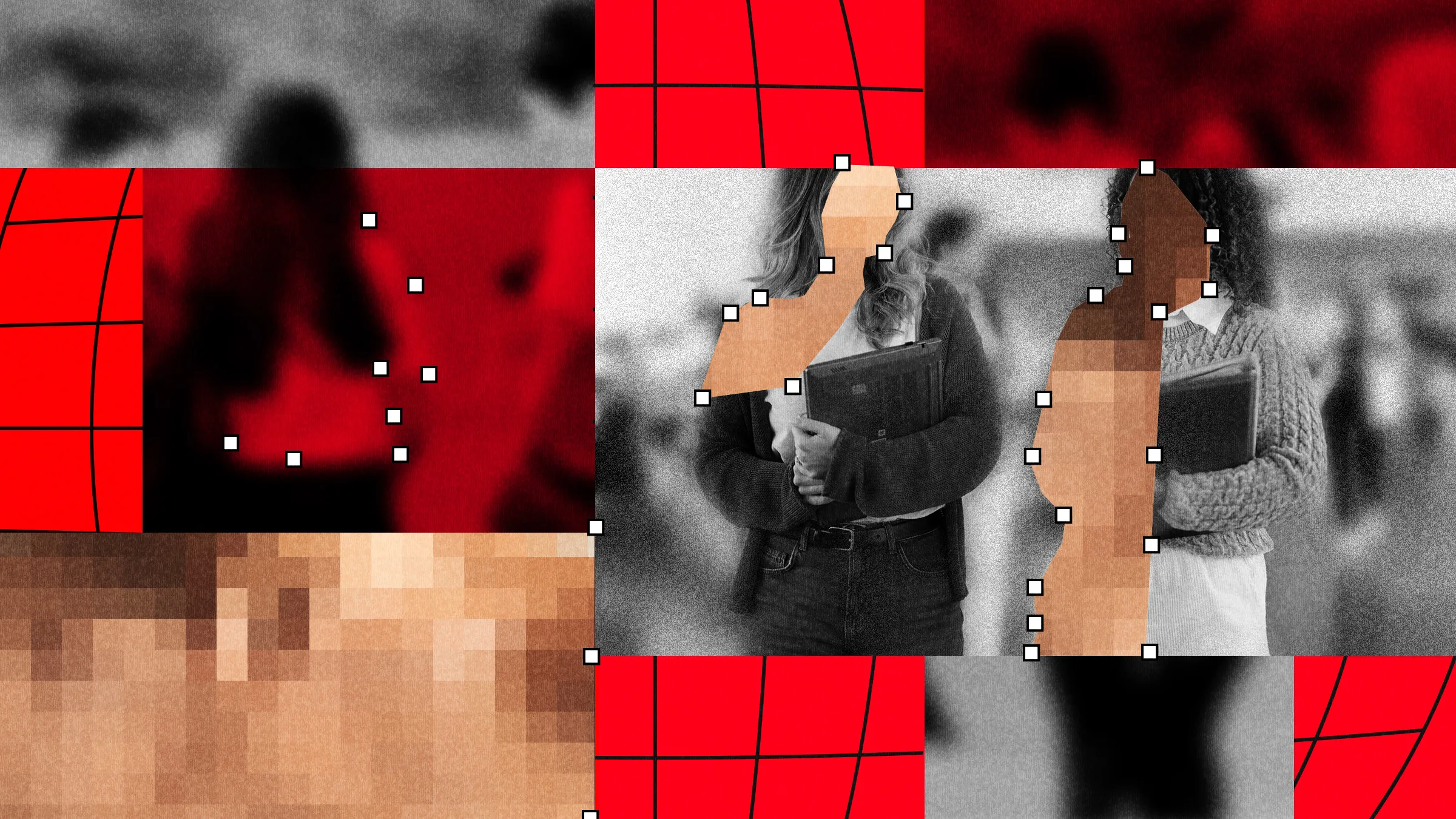

Deepfake-Nacktbilder-Krise betrifft Hunderte Schüler weltweit

Eine verstörende Untersuchung hat aufgedeckt, dass die Geißel KI-generierter Deepfake-Nacktbilder eine weit verbreitete globale Krise ist, die Hunderte von Schülern betrifft, und keine Reihe isolierter Vorfälle. Die von WIRED und Indicator durchgeführte Analyse ergab, dass fast 90 Schulen und etwa 600 Schüler in mehreren Ländern Opfer dieser Technologie geworden sind, die für Belästigung und Mobbing instrumentalisiert wird.

Der Bericht zeichnet das Bild eines rasch wachsenden Problems ohne Anzeichen einer Verlangsamung. Täter, oft Mitschüler, nutzen leicht zugängliche KI-Werkzeuge, um nicht einvernehmliche gefälschte Nacktbilder ihrer Altersgenossen zu erstellen. Dieser digitale Missbrauch verursacht bei den Opfern schweres psychologisches Trauma, schädigt ihren Ruf und schafft ein Umfeld der Angst und Verletzung innerhalb der Schulgemeinschaften.

Das Ausmaß und die Leichtigkeit, mit der diese Belästigung nun durchgeführt werden kann, erfordern dringende und vielschichtige Gegenmaßnahmen. Schulen, Tech-Plattformen und Gesetzgeber kämpfen damit, Schritt zu halten. Die Krise unterstreicht den unmittelbaren Bedarf an besserer digitaler Bildung, robusten Meldeverfahren auf Social-Media-Plattformen und potenziell neuen rechtlichen Rahmenbedingungen, um diese spezifische Form des bildbasierten sexuellen Missbrauchs zu adressieren. Da die Technologie zur Erstellung überzeugender Fälschungen noch zugänglicher wird, schließt sich das Zeitfenster für wirksame Interventionen, was koordinierte Maßnahmen der Gesellschaft erfordert, um gefährdete Personen vor dieser neuen Schadensfront zu schützen.